Fotosensores - Capturando la imagen

Los fotógrafos le dan mucha importancia a la resolución de la imagen. Las lentes se clasifican según su resolución, esencialmente su capacidad para convertir una escena en una imagen nítida. La película también tiene una resolución, con emulsiones de baja velocidad que proporcionan una mayor nitidez que los materiales rápidos.

Por lo tanto, no es sorprendente que una de las características más importantes de una cámara digital se haya convertido en su recuento de píxeles. Pero, ¿qué es un píxel, por qué hay tantos y cómo afectan la resolución de la imagen?

Pintar por númerosDentro de cada cámara digital, en lugar de película, hay una matriz de sensores. Como su nombre indica, este es un grupo de fotosensores dispuestos en forma de cuadrícula.

Un fotosensor reacciona a la luz creando una carga eléctrica. Cuanto más brillante es la luz, mayor es la carga. Si mide el valor de esta carga, puede determinar el brillo de la luz que la creó. Con esta información, puede reproducir el efecto de esta luz en la pantalla de una computadora o en una hoja de papel.

Si solo hubiera un sensor fotográfico grande, toda la luz de la escena se promediaría en un solo tono y la imagen sería de un gris uniforme. Duplique el número de sensores y capturará el doble de la cantidad de información: su imagen sería dos bloques grises, aunque probablemente de tonos ligeramente diferentes.

A medida que aumenta el número de sensores, aumenta la cantidad de información de la imagen. Eventualmente, llega a un punto donde hay suficiente información para que aparezca una imagen reconocible.

Es muy parecido a crear un mosaico con pequeños mosaicos que varían en tono de blanco a negro a través de una gama de grises. Cada mosaico tiene un solo tono, pero al colocar mosaicos de diferentes tonos uno al lado del otro, puede construir una imagen.

Las primeras cámaras digitales usaban conjuntos de sensores basados en una cuadrícula de 640 columnas por 480 filas, lo que daba poco más de 0,3 millones de sensores agrupados en el conjunto. Esto suena mucho, pero aunque las imágenes producidas se ven bien como impresiones pequeñas, la falta de detalles se hace evidente rápidamente cuando las imágenes se amplían.

La primera cámara digital EOS, la DCS 3, ofrecía 1.3 millones de sensores (o megapíxeles). Esto fue en 1995. Sin embargo, fue la EOS D60 de 6.3 megapíxeles (2002) la que realmente comenzó a competir con las cámaras de cine.

Con solo unos pocos píxeles, la resolución de una imagen es tan pobre que el sujeto es irreconocible. A medida que aumenta el número de píxeles, el sujeto se vuelve claro.

Elementos de imagen (píxeles)

La información proporcionada por cada sensor fotográfico se denomina elemento de imagen. Esto generalmente se acorta a "píxel" (pix es una abreviatura común para "imágenes"). Por asociación, el término píxel también ha llegado a significar un solo fotosensor en la matriz de sensores. Entonces, ¿cuántos píxeles necesitas para producir una imagen con buenos detalles?

Bueno, aunque las comparaciones directas no son posibles, algunas fuentes sugieren que necesita alrededor de 100 millones de píxeles para acercarse a la resolución proporcionada por el ojo humano. Del mismo modo, se estima que la resolución de una película de color de grano fino es equivalente a alrededor de 18 millones de píxeles.

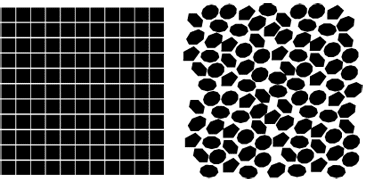

En la práctica, estas cifras parecen bastante altas. Canon dice que 10 millones de píxeles dan una resolución similar a la de la película. Por supuesto, algunos usuarios de películas afirman que lo digital nunca puede dar los mismos resultados que las películas, y probablemente tengan razón. Los sensores digitales están formados por píxeles alineados con precisión en una cuadrícula ordenada. La película tiene sus cristales fotosensibles dispersados al azar a través de la emulsión. Esto tiende a dar a las imágenes digitales una apariencia muy "suave", mientras que las imágenes de película tienen más "caracteres".

La elección entre los dos es puramente subjetiva. Tanto la digital como la película son capaces de proporcionar imágenes de excelente calidad.

La matriz de sensores más grande actualmente disponible para cámaras digitales EOS es de 22.3 millones, en la EOS 5D Mark III.

Los sensores digitales están dispuestos en una cuadrícula ordenada. Los granos de película se dispersan al azar en la emulsión.

Color de grabación

Un píxel no puede ver en color. Simplemente registra el brillo de la luz recibida. Para producir una imagen en color, la matriz de sensores se superpone con una cuadrícula de pequeños filtros de color. Cada filtro cubre un sensor. Hay tres colores de filtro diferentes: rojo (R), verde (G) y azul (B), pero con dos filtros verdes para cada filtro rojo y azul. Esto proporciona un microcluster de cuatro filtros que se repite en toda la matriz de sensores. (El verde se elige como el filtro preferido para emular la mayor sensibilidad del ojo humano al verde).

Un píxel cubierto por un filtro rojo solo ve luz roja; un píxel cubierto por un filtro azul solo ve luz azul; un píxel cubierto por el filtro verde solo ve luz verde. Esto sugiere que el sensor solo captura un tercio de la cantidad de datos de color en comparación con los datos de brillo, pero este no es el caso. Cada píxel realmente muestrea la información de color de los píxeles adyacentes para proporcionar datos a todo color con el brillo de cada píxel. Esto puede parecer un compromiso, pero funciona extremadamente bien en la práctica.

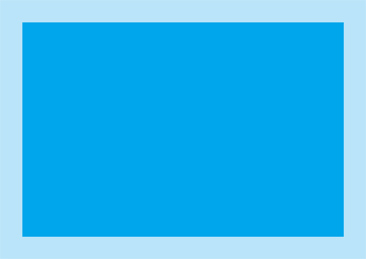

Esta muestra es la que explica la diferencia entre el número total de píxeles en un sensor y el número menor de píxeles "efectivos". Los píxeles efectivos son aquellos que se encuentran dentro del área real de la imagen. Los píxeles restantes forman un borde para la imagen. Reciben luz del sujeto y sus datos son muestreados por los píxeles efectivos en el borde del área de la imagen. Esto significa que todos los píxeles efectivos muestrean datos de píxeles adyacentes en todas las direcciones. Evita que los píxeles en el borde del área de la imagen tengan datos de color reducidos.

Un solo sensor fotográfico solo puede capturar datos para un solo color. Sin embargo, al colocar un microgrupo de filtros rojo, verde y azul sobre cada grupo de cuatro sensores, se pueden registrar datos para una imagen a todo color. Esta red de microclusters se repite en todo el sensor.

Los algoritmos (conjuntos de reglas) utilizados por los píxeles para recopilar datos de color son extremadamente complejos y pueden tomar datos de píxeles no adyacentes. Es por eso que el borde de los píxeles no efectivos tiene más de un píxel de profundidad.

La calidad de los algoritmos juega un papel importante en la calidad de la imagen en color. Cada fabricante de cámaras mantiene sus algoritmos como un secreto muy bien guardado.

El sensor en una cámara EOS tiene más píxeles de los necesarios para formar la imagen principal. En esta ilustración, el píxel azul oscuro muestra los píxeles formadores de imagen, o "efectivos". El área exterior (azul claro) representa los píxeles que se utilizan para mejorar los datos de color de los píxeles efectivos. Ambas áreas juntas dan el recuento de píxeles 'total' visto en las especificaciones de la cámara.

Referencias